Forschungsprojekt

PulsCam

Berührungslose Vitaldatenerfassung

Aktuell

PulsCam auf der Auftaktveranstaltung zum Wissenschaftsjahr 2026

Das FZI Forschungszentrum Informatik präsentiert PulsCam als Exponat auf der Auftaktveranstaltung zum Wissenschaftsjahr 2026. Das Bundesministerium für Forschung, Technologie und Raumfahrt präsentiert das Thema „Medizin der Zukunft“ und zeigt innovative Forschungsprojekte wie PulsCam.

Datum: 20. Januar 2026, Einlass ab 17:00 Uhr

Ort: Futurium

Alexanderufer 2

10117 Berlin

Motivation

- Prozessoptimierung in der Notaufnahme

- Kontaktlose Perfusionsmessung

- Fahrerzustandsüberwachung

- Deep-Fake-Erkennung

PulsCam steht damit für die innovative Verbindung von Forschung und Praxis und unterstützt gezielt den Technologietransfer in medizinische, sicherheits- und mobilitätsbezogene Anwendungen.

Anwendungsbereiche

Notaufnahme

Die Überwachung von Vitaldaten wie Atemfrequenz, Herzfrequenz und Bewegungsmustern kann wichtige Hinweise auf gesundheitliche Risiken liefern und dabei helfen, medizinische Notfälle frühzeitig zu erkennen. Traditionelle Methoden zur Erhebung dieser Daten erfordern oft direkten Körperkontakt oder störende Geräte. Mit neuen Technologien möchten wir eine berührungslose, kontinuierliche und komfortable Überwachung Ihrer Vitaldaten während Ihrer Aufnahme in der Zentralen Notaufnahme ermöglichen.

Forscher*innen am FZI entwickeln gemeinsam mit klinischen Partner*innen ein System für berührungslose, kontinuierliche und komfortable Überwachung von Vitaldaten während der Aufnahme in der Zentralen Notaufnahme. Zukünftige Erweiterungen umfassen die Integration weiterer Parameter wie Atemfrequenz, Blutdruckindizes [5] und Blässe-Detektion, um das Monitoring noch umfassender zu gestalten.

Perfusionsmessung

Im Rahmen des Projekts HybridVita wurde die Perfusionsmessung mittels remote Photoplethysmographie (rPPG) nach dem POS-Algorithmus eingesetzt, um den Verlauf chronischer Hautkrankheiten zu beobachten. Die Methode basiert auf der Analyse kleinster Farbänderungen der Haut durch videobasierte Photoplethysmographie, wodurch Rückschlüsse auf die lokale Perfusion möglich sind. Es konnte gezeigt werden, dass erkrankte Haut Perfusionsmuster aufweisen, die sich von denen gesunder Haut unterscheiden [4]. Durch kontinuierliche Messungen über mehrere Tage bei stationären Patient*innen war eine Verlaufskontrolle der Krankheit realisierbar, sodass Veränderungen der Perfusion einen Zusammenhang zum Krankheitsstatus des Patienten zeigten.

Diese Erkenntnisse eröffnen Perspektiven für fortführende Studien, in denen rPPG-basierte Perfusionsmessungen genutzt werden könnten, um akute Schübe chronischer Erkrankungen, wie beispielsweise der Psoriasis, frühzeitig vorherzusagen und die Therapie entsprechend anzupassen.

Fahrerzustandsüberwachung

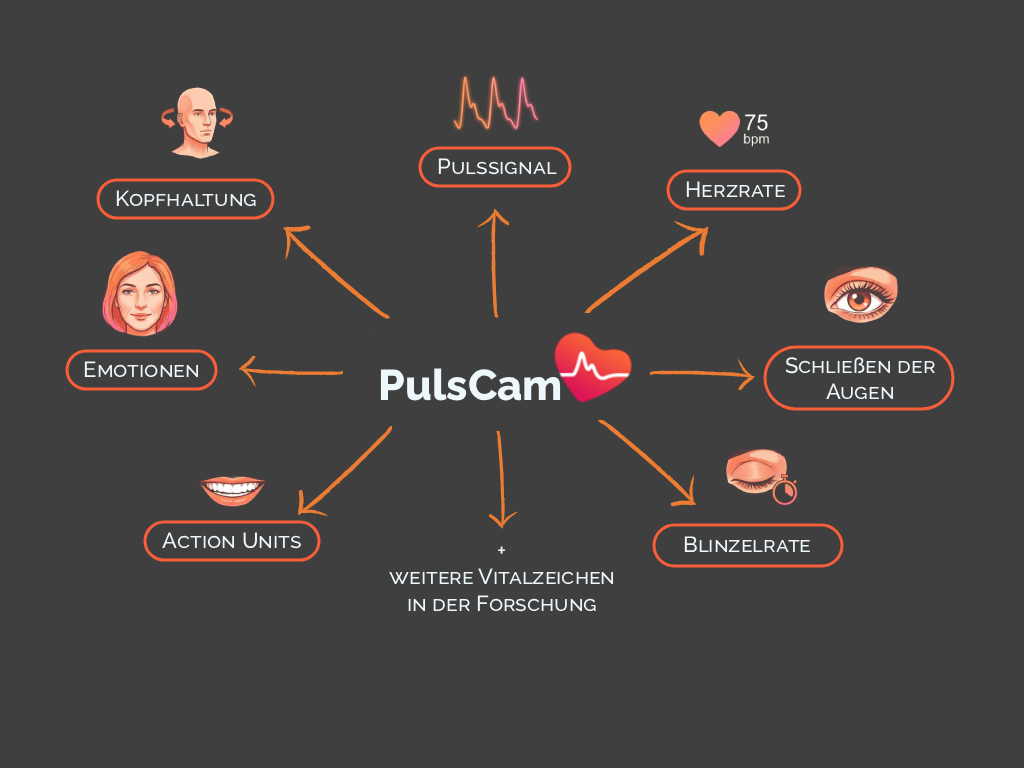

Um den Fahrerzustand möglichst umfassend zu erfassen, entwickelten Forscher*innen am FZI ein kamerabasiertes System. Dieses erfasst und verfolgt mittels einer Kamera im Fahrzeuginnenraum das Gesicht der fahrenden Person und wertet es hinsichtlich der Parameter Herzrate, Blinzelrate, Kopfhaltung und Emotion aus.Die Besonderheit des Ansatzes ist, dass dies über eine handelsübliche Webcam ohne zusätzliche Technik am Körper der fahrenden Person oder spezielle Beleuchtung erfolgt, was eine kostengünstige Anwendung im Fahrzeug ermöglicht. Die Herzratenerfassung erfolgt optisch über die Analyse von blutpulsationsabhängigen Farbwertänderungen im Gesicht des Fahrers. Relevante Gesichtsbereiche werden mit Hilfe innovativer Bild- und Signalverarbeitungsalgorithmen analysiert. Die Lidschlagdetektion, Mimikerkennung und Schätzung der Kopfpose beruhen auf der Auswertung von Merkmalen eines entwickelten Modells des Fahrergesichts mittels entsprechend trainierter Klassifikatoren.

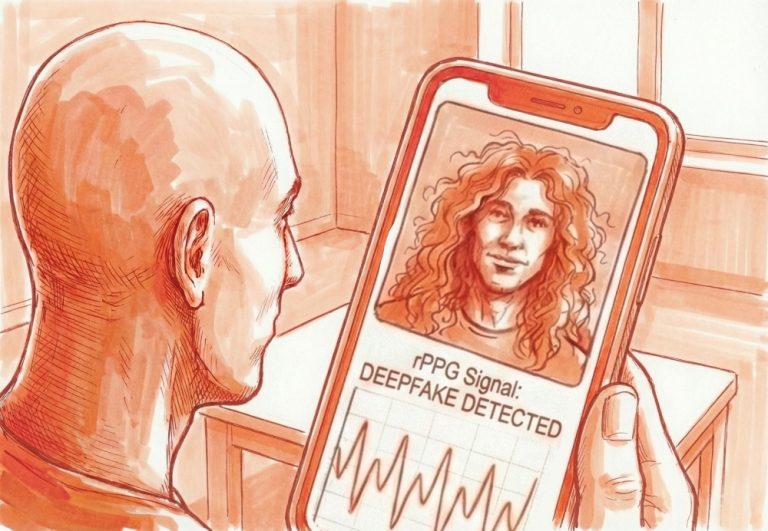

Deep-Fake-Erkennung

Die Deep-Fake-Erkennung befasst sich mit der automatisierten Identifikation manipulierter Videos, in denen Gesichter mithilfe generativer künstlicher Intelligenz (genKI) realistisch verändert oder vollständig synthetisch erzeugt werden. Solche Fälschungen sind für Menschen zunehmend schwer zu erkennen und stellen eine wachsende Herausforderung für Medienvertrauen und IT-Sicherheit dar. Ein vielversprechender Ansatz zur Detektion basiert auf der Analyse mittels Remote-Photoplethysmographie (rPPG), bei der Forscher*innen physiologische Signale kontaktlos aus Gesichtsaufnahmen extrahieren. Da der menschliche Blutfluss feine, zeitlich konsistente Farbänderungen im Gesicht verursacht, lassen sich manipulierte Videos anhand lokaler und zeitlicher Inkonsistenzen identifizieren. Durch die Auswertung von Pulssignalen aus verschiedenen Gesichtsregionen in Kombination mit lernbasierten Modellen können Deepfakes mit hoher Zuverlässigkeit erkannt werden.

Diese Methodik wird unter anderem im Projekt MuDDi (Multi-modal Deepfake Detection) eingesetzt, einem digitalen forensischen Werkzeug zur Analyse und Erkennung manipulierter Inhalte in Videos und Bildern. MuDDi kombiniert rPPG-basierte Verfahren mit weiteren multimodalen Analyseansätzen und ermöglicht so eine robuste Deep-Fake-Erkennung auch unter variierenden Lichtbedingungen, mit unterschiedlichen Kameras und bei natürlichen Gesichtsausdrücken.

Evaluierungen zeigen dabei Erkennungsraten mit AUC-Werten (Area Under the Curve) von bis zu 97 Prozent.

Modulare Systemarchitektur

Die PulsCam-Software ist modular aufgebaut und kann sowohl als eigenständiges System als auch in bestehende medizinische oder sicherheitsrelevante Systeme integriert werden. Die einzelnen Analyseblöcke – wie Puls-/Herzfrequenz, Gesichtsverfolgung, Emotionserkennung und Signalverarbeitung – sind unabhängig voneinander entwickelt und können selektiv aktiviert oder deaktiviert werden. Die Integration in bestehende Systeme wird dadurch deutlich erleichtert, dass PulsCam auf handelsüblichen Kamerasystemen basiert und moderne Bildverarbeitungs- und Künstliche-Intelligenz (KI)-Algorithmen für die Echtzeitverarbeitung nutzt.

Technische Lösung

Gesichtserkennung

Kopfhaltung, Augenverschluss und Blinzelrate werden mithilfe moderner Verfahren zur Analyse von Gesichtslandmarks ausgewertet. Robuste Landmark-Tracker detektieren charakteristische Punkte im Gesicht (z. B. an Augenlidern, Pupillen, Nasenrücken und Mundwinkeln) und verfolgen deren Position im Zeitverlauf. Aus den relativen Bewegungen und Abständen dieser Punkte lassen sich Kopfpose (Pitch, Yaw, Roll), das Schließen der Augen sowie die Blinzelrate zuverlässig ableiten, was eine kontinuierliche Einschätzung von Aufmerksamkeit und Müdigkeit ermöglicht.

Remote Photoplethysmographie (rPPG)

Das FZI nutzt Remote-Photoplethysmographie (rPPG), eine nicht-invasive Technologie, die subtile Farbveränderungen im Gesicht analysiert. Dabei wird mit Hilfe einer Kamera das Gesicht aufgenommen, wobei insbesondere Stirn- und Wangenbereiche detektiert werden, um dort eine Photoplethysmographie-Messung durchzuführen. Durch das im Blut enthaltene Hämoglobin wird Licht absorbiert, was bei variierendem Blutvolumen im Herzzyklus in der Haut zu minimalen Farbunterschieden führt, die im Video messbar sind.

PulsCam kombiniert eine handelsübliche Webcam mit einem adaptiven Short-Window-Network (SWN) [1], einem tiefen neuronalen Netzwerk mit Encoder-Decoder-Architektur, das Remote-PPG-Signale extrahiert und weiterverarbeitet. Das System erreicht eine für die Herzfrequenzmessung klinisch relevante Genauigkeit. In Validierungsstudien auf dem VitalCamSet-Datensatz [2] (120-Sekunden-Videos bei 30 fps) erzielte PulsCam einen mittleren absoluten Fehler (Mean Absolute Error, MAE) von 0,75 Schlägen pro Minute und einen Root-Mean-Square-Error (RMSE) von 2,44 bpm. Die Erfolgsrate lag bei 95,53 Prozent, definiert als Anteil der Vorhersagen innerhalb einer Toleranz von ±3 bpm [1].

Durch die Remote-Photoplethysmographie-Technologie können wir zudem die Pulsratenvariabilität (PRV) kontaktlos mittels Kamera erfassen. Die PRV ist hoch mit der Herzratenvariabilität (HRV) korreliert und ermöglicht somit eine berührungslose Einschätzung emotionaler Zustände ohne direkten Sensor-Haut-Kontakt.

Emotionserkennung

Wir führen die Emotionserkennung durch die Analyse von Action Units (AU) durch, die aus Gesichtsmerkmalen berechnet werden. Action Units sind definierte Muskelbewegungen im Gesicht.

Im ersten Schritt bestimmen Algorithmen Gesichtspunkte und extrahieren einen Bildausschnitt. Anschließend gewinnen sie Scale-Invariant-Feature-Transform (SIFT)-Features aus markanten Punkten im Gesicht und wandeln diese mittels eines Klassifikators in AU-Werte um.

Für den Klassifikator werden Gewichtungsmatrizen für die obere und die untere Gesichtshälfte verwendet. Die Klassifikation erfolgt durch eine lineare Transformation der extrahierten SIFT-Features, wobei eine Mittelwertsanpassung vorgenommen wird. Diese resultierenden AU-Werte repräsentieren die Intensität bestimmter Gesichtsausdrücke, die mit Emotionen korrelieren.

Für die Emotionsklassifikation extrahieren wir aus den kamerabasierten Signalen der Pulsratenvariabilität (PRV) Merkmalsvektoren und werten diese mit verschiedenen Machine-Learning-Verfahren aus.

In Experimenten wurden zehn unterschiedliche Verfahren zur Emotionserkennung untersucht; das beste Klassifikationsmodell erzielte einen Korrelationskoeffizienten von 0,34 für die Valenz-Erkennung (positiv/negativ) und 0,36 für die Arousal-Erkennung (Erregungsniveau) [3].

Die rPPG‑basierte Messung liefert bei der Erkennung von HAHV‑Emotionen (High‑Arousal, High‑Valence), etwa Freude oder Begeisterung, besonders vielversprechende Ergebnisse mit hoher Genauigkeit. Bei Emotionen mit weniger ausgeprägten physiologischen Veränderungen, wie beispielsweise bei Traurigkeit, übertrifft die PRV‑basierte Methode in unseren Studien sogar ein tiefes neuronales Netz zur Gesichtsausdrucksanalyse.

Projektleitung

Wissenschaftliche Mitarbeit

Veröffentlichungen

(Auswahl)

[1] Zhou, K., Krause, S., Blöcher, T., & Stork, W. (2021). Short window network for remote heart rate measurement. In Proceedings of the IEEE 9th International Conference on Healthcare Informatics (ICHI) (pp. 200–208). IEEE. doi: 10.1109/ICHI52183.2021.00039

[2] Blöcher, T., Krause, S., Zhou, K., Zeilfelder, J., & Stork, W. (2019). VitalCamSet: A dataset for photoplethysmography imaging. In Proceedings of the IEEE Sensors Applications Symposium (SAS) (pp. 1–6). IEEE. doi: 10.1109/SAS.2019.8705999

[3] Zhou, K., Schinle, M., & Stork, W. (2023). Dimensional emotion recognition from camera-based PRV features. Methods, 218, 224–232. doi: 10.1016/j.ymeth.2023.08.014

[4] J. Hofmann et al. (2023)5 Perfusion Analysis for Telemedical Long-Term Monitoring of Patients with Chronic Skin Diseases. 6th International Conference in Electronic Engineering & Information Technology (EEITE), doi: 10.1109/EEITE65381.2025.11166425

[5] Biri, G. I., He, X., & Stork, W. (2024). Towards a Standardized Evaluation Framework for Camera-Based Contactless Blood Pressure Monitoring: A Comprehensive Review. In Proceedings of the IEEE-EMBS Conference on Biomedical Engineering and Sciences (IECBES) (pp. 278–283), Penang, Malaysia. IEEE. doi: 10.1109/IECBES61011.2024.10990432